In diesem Beitrag erfahren Sie, warum es stets sinnvoll ist Chat GPT Content im Quercheck auf seine Korrektheit zu überprüfen bevor man den Inhalt selbst verwendet. Chat GPT hält eine Menge an Stolpersteinen bereit, welche bei unsachgemäßer Verwendung zu peinlichen Situationen führen kann, wenn man von Chat GPT generierten Content nicht überprüft zur Content-Produktion für eigene Werke verwendet. Grundsätzlich ist es aber nicht ausgeschlossen (wenn gleich fraglich dies überhaupt zu tun) Chat GPT Content für sich und seine Arbeit zu nutzen, nur muss einem dabei bewusst sein, dass man den KI-generierten Content auf seine Korrektheit überprüft und bei Bedarf entsprechend anpasst. Grundsätzlich ist es aber immer empfehlenswert sich von Chat GPT nur ein wenig „inspirieren“ zu lassen und den Content Großteils durch eigene Denkarbeit zu erstellen.

Konkretes Beispiel für einen Chat GPT Content-Quercheck

Um zu verdeutlichen, wie so ein inhaltlicher Stolperstein durch Chat GPT generierten Content aussehen kann, möchte ich folgendes Beispiel dazu präsentieren. Im Prinzip handelt es sich dabei nur um einen kleinen Stolperstein, der von einem Laien (oder jemanden, der nur schnell darüber hinweg liest) kaum als solcher identifiziert wird. Doch jemand mit Erfahrung zu diesem Thema, oder jemand der sich wirklich inhaltlich tiefer damit auseinander setzt, wird mit einer wesentlichen Fehlinformation gefüttert.

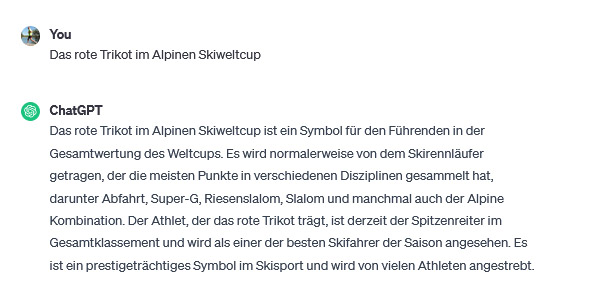

„Okay, vielen Dank Chat GPT für diese schöne und wertschätzend ausformulierte Antwort“, denkt man sich im ersten Moment. Doch wenn man sich bereits ein wenig mit der Thematik auskennt, dann fällt einem bei bewussten Lesen unweigerlich sofort auf, dass hier Falschinformation enthalten ist, und das gleich im ersten Satz: „Das Rote Trikot im alpinen Skiweltcup ist ein Symbol für den Führenden in der Gesamtwertung des Weltcups.“ Dann folgt ein Satz der sich auf die einzelnen Disziplinen bezieht, was kurz eine korrekte Annahme suggeriert. Doch im darauf folgenden Satz wird mit der Aussage „.. ist derzeit der Spitzenreiter im Gesamtklassement ..“ die Tendenz zur Korrektheit wieder zunichte gemacht.

Entsprechend meiner Fachkenntnis zu diesem Thema habe ich Chat GPT auf den Fehler aufmerksam gemacht um zu sehen, wie Chat GPT damit umgehen wird:

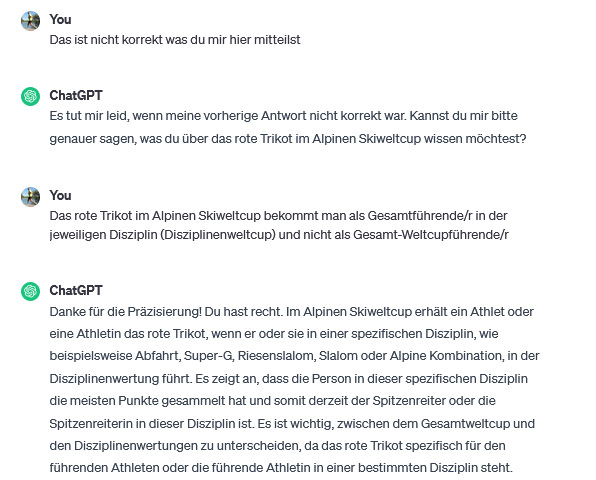

Chat GPT ist wirklich sehr höflich und nett. Dies ist ja furchtbar lieb und äußerst wertschätzend von dieser netten KI, die ja nur dafür da ist, um uns zu helfen und unser Leben zu vereinfachen. Nur leider ist das nicht das Papier wert, auf das es gedruckt werden könnte, wenn man es ausdrucken würde.

So wie in der Politik, bringen uns nette und gut gemeinte Worte nichts, wenn diese keinen Nutzen – oder nur Schaden durch Desinformation – bringen. Insofern ist dieses Beispiel stellvertretend für unzählige andere Fälle keinesfalls eine Banalität, sondern systematische Desinformation für (gegen) die Gesellschaft, wenn Unwahrheiten nett und seriös verpackt werden um Wahrheit zu suggerieren.

Sie meinen nun vielleicht: „Was für harte Worte für so eine Kleinigkeit!“ Meine Antwort: „Das ist keineswegs eine Kleinigkeit, ganz und gar nicht. Und warum, das werde ich Ihnen in folgenden zwei Begründungen erklären.“

- Der eine Grund liegt in der Nichtlinearen Dynamik (Schmetterlingseffekt) verborgen. Dies hat etwas mit der sogenannten Chaostheorie zu tun, welche die Wahrscheinlichkeit einer unvorhersehbaren Kettenreaktion, ausgelöst durch eine Kleinigkeit, ungeahnten Ausmaßes mit sich bringen kann. Dieser Effekt ist mittlerweile in vielen zentralen Bereichen unserer weitgehend automatisierten Gesellschaft (Beispiel: Börsen- und Aktienmarkt, Weltwirtschaft, … auch im Contentmarketing …) tagtäglich zu finden und nur sehr eingeschränkt kontrollierbar, und das auch nur wenn man die Vorzeichen sehen und rechtzeitig verstehen kann, um einzugreifen bevor es zu spät ist (Point of no Return). Und genau so ist es mit Falschinformationen: Sind diese erst einmal entsprechend gestreut, dann ist es meistens nur sehr schwer, diesen Schaden wieder zu korrigieren. Wenn wir Menschen erst einmal eine Information als Wahrheit für uns emotional manifestiert haben, so ist diese Informationen für uns dann ein Teil unserer Realität. Und selbst wenn wir irgendwann einmal später eines Besseren belehrt werden, so ist es auch dann noch für Viele sehr schwierig, sich das einzugestehen und bereits Manifestiertes durch Neues zu ersetzen. Speziell die letzten Jahre haben das sehr deutlich gezeigt wie das Wesen des Menschen dahingehend gestrickt ist. Zudem ist es immer besser, effizienter und einfacher Falsches erst gar nicht zuzulassen und Dinge von Grund auf richtig zu machen. Falsches nachträglich richtig zu stellen verursacht immer mehr „Reibungsverlust“ und einen schlechteren Wirkungsgrad für das Ergebnis. Insofern sollte nun klar sein, dass das KI-generierte streuen von Falschinformationen im großen Stil (weil es der breiten Öffentlichkeit zur Verfügung steht) keine Kleinigkeit ist.

- Der zweite Grund für meine harten Worte hat mit dem weiteren Umgang von Chat GPT zu tun. Ich hätte mir nun von einer intelligenten und moralisch unbedenklichen künstlichen Intelligenz erwartet, dass meine Hilfestellung zur korrekten Sachverhaltsdarstellung von Chat GPT übernommen wird. Schließlich wird ja auch von der KI-Lobby „maschinelles Dazulernen“ suggeriert. Es wird damit ein Anschein erzeugt, dass die KI so intelligent ist, selbst dazu zu lernen um für uns alle besser zu werden. Dass das im Grunde genommen eine riesige Mogelpackung ist und sogar die Absurdität von Chat GPT als künstliche Intelligenz zu bezeichnen im Raum steht, weil unterbezahlte Manpower aus Billiglohnländern stetig im Einsatz sind, Fehler zu korrigieren, ist sehr bezeichnend für die Problematik. Dieser Umstand ist quasi als Schuldeingeständnis der KI-Entwickler zu sehen, dass sie es einfach nicht in der Hand haben (Stichwort: Chaostheorie), was für einen Müll Chat GPT produziert. Doch lesen Sie nun den letzten Teil meines Chat GPT Content Querchecks:

Besorgnis über den Umgang mit Chat GPT-Fehlern

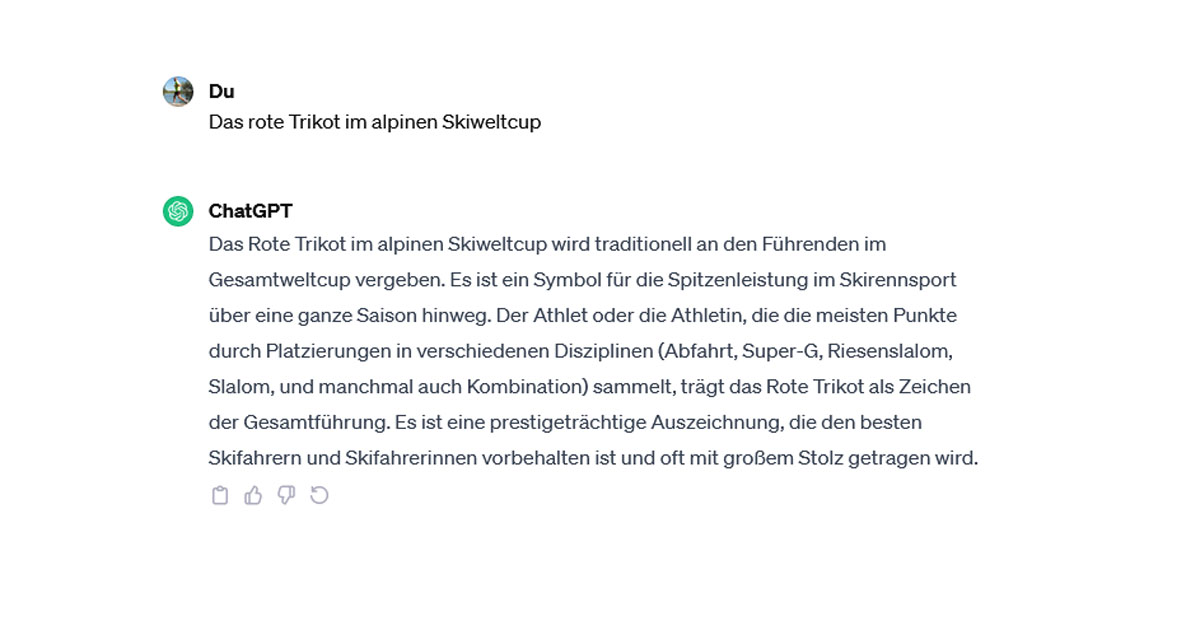

Das für mich wirklich Erstaunliche und zugleich Tragische bei der ganzen Content-Sache rund um Chat GPT ist die gewisse Lernresistenz dieser KI. Selbst nach wochenlanger Wartezeit hat sich der Informationsgehalt zu diesem Thema nicht verändert. Chat GPT antwortet nach wie vor (Stand: Dezember 2023) mit falschen Angaben:

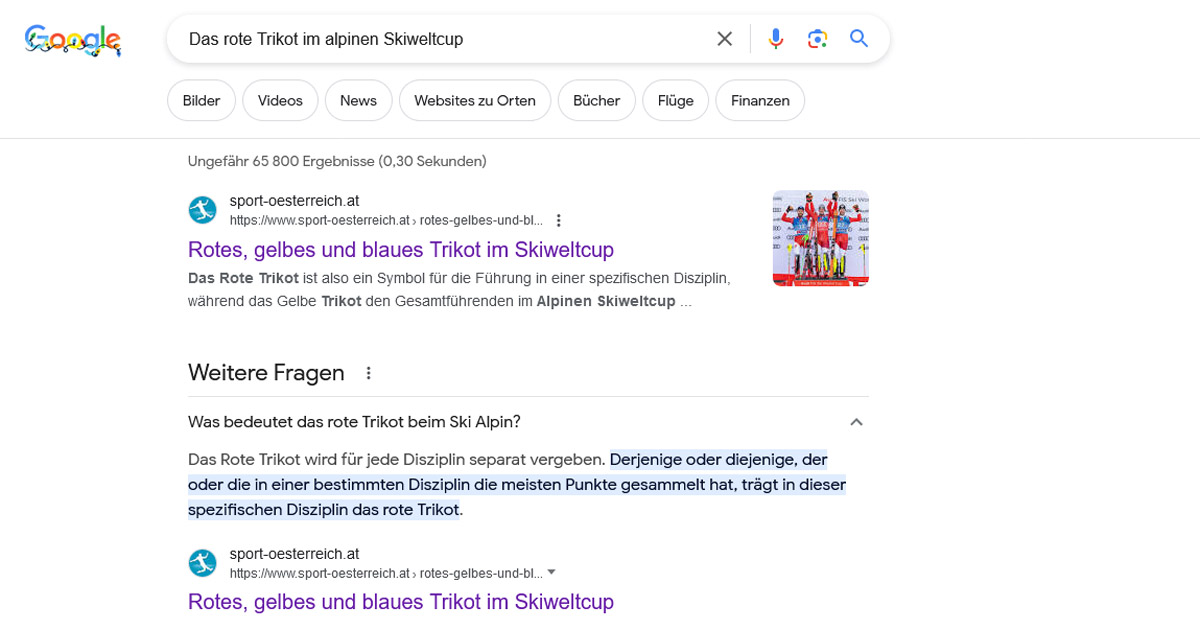

Ja, Chat GPT formuliert die Frage nun etwas anders, aber der grundlegende Fehler in der Antwort ist nach wie vor vorhanden. Insofern ist die KI hinter Google Search-Suchergebnis-Algorithmen für mich wesentlich fortschrittlicher als Chat GPT, der aus meiner Sicht seine surreale Welt der Desinformationen nur sehr ungern verlässt.

Ich habe auf sport-oesterreich.at einen selbst recherchierten und fachlich fundierten Artikel verfasst, der unter anderem die Bedeutung des roten Trikots im alpinen Skiweltcup erklärt. Google hat sich dafür mit einem hervorgehobenen Top 1 Suchergebnis bedankt.